KI (AI – Artificial Intelligenz) ist bereits überall präsent: In Suchmaschinen, Social-Media und integriert in Onlineshops und auf Unternehmens-Internetpräsentation als Chatbot.

Aber kann es auch bei Rechtsproblemen durch Sachverhaltserfassung und Erarbeitung passender Lösungen unterstützen?

von RA Stefan Musiol

Unterstützung bei Suchrecherchen

Natürlich besitzt KI auch mit den eingesetzten Hochleistungs-Prozessoren keine menschliche Intelligenz, sondern nur ein erweitertes System für Mustervergleiche, das Antworten auf Fragen aus vorgegebenen oder selbst recherchierten und analysierten Daten ermittelt.

Aber viele Fragen schon einmal gestellt und in Aufsätzen beantwortet und es gibt für ein Problem meist auch schon dokumentierte Lösungswege.

Eigentlich könnte es damit ja klappen. Wir haben daher stufenweise mit gesteigerten Anforderungen getestet:

Die reine Suche im Internet über Begriffe mit der klassischen Suchmaschine ist so alt wie das Internet, aber insbesondere bei der Suche nach Antworten auf komplexere Problemstellungen entsprechend aufwendig.

Wer die Studienlage aus wissenschaftlichen Veröffentlichungen zu einer komplexen Frage zusammenstellen will oder die Meinung der wichtigsten Gerichte aus einschlägigen Gerichtsurteilen zu einer Rechtsfrage, musste sich bisher aus den gefundenen Suchergebnissen mit umfangreichen Aufsätzen oder Gerichtsurteilen noch mit Textrecherchen die relevanten Stellen heraussuchen.

Gerade weil es mit Intelligenz wenig zu tun hat, kann diese Aufgabe schon logisch auch ganz ohne „Intelligenz“ angepassten Algorithmen zu überlassen werden.

Der Suchbot bei Google oder auch ChatGPT liefern die Bots auch in kürzester Zeit jeweils passende und gut aufbereitete Ergebnisse, die jeweils mit Fundstellen belegt werden. Die Ergebnisse sind auch bei sehr „exotischen“ Fragestellungen, zu denen wenig zu finden ist, nahezu immer hilfreich.

Fehler treten immer dann auf, wenn die KI tatsächlich intelligent sein müsste, was sie nun einmal noch nicht ansatzweise ist: Ergebnisse auf ihre Bedeutung zu bewerten und zu differenzieren.

Es bleibt also bei der Durchsicht der gefundenen Quellen auf ihre inhaltliche Bedeutung.

Sprachunterstützung

Hier zeigen die Chatbots, wofür sie eigentlich programmiert wurden: Mit hoher Qualität können die Programme die Ergebnisse aus vielfacher Textauswertung einsetzen, um nicht nur Aussagen in richtiger Grammatik und verständlich zu formulieren, sondern ihren Stil auch den Anforderungen und dem Adressaten anpassen.

Hier zeigen die Chatbots, wofür sie eigentlich programmiert wurden: Mit hoher Qualität können die Programme die Ergebnisse aus vielfacher Textauswertung einsetzen, um nicht nur Aussagen in richtiger Grammatik und verständlich zu formulieren, sondern ihren Stil auch den Anforderungen und dem Adressaten anpassen.

Selbst ein undeutliches Diktat in einer eher unbekannten Fremdsprache, z.B. das Vorlesen einer handschriftlichen Notiz oder eines Berichts, führte zu einer fast durchweg akkuraten Erfassung des Textes, der anschließend einwandfrei übersetzt werden konnte – und das ohne jedes Anlernen. Diese Funktionalität dürfte die herkömmlichen Diktatprogramme jedenfalls leicht ersetzen, wenn nicht in den Schatten stellen. Zudem kann die Software die Inhalte auch gleich binnen Sekunden „im Ton“ anpassen.

Die unsererseits gestellten Übersetzungsaufgaben hat ChatGPT dementsprechend fast fehlerfrei erledigt. Nur selten und nur bei komplexen Aussagen ging die Übersetzung am Sinn vorbei.

Dennoch ist zu empfehlen, wichtige Übersetzungen vorsorglich mit einem zweiten System oder per Rückübersetzung nochmals gegenzuprüfen, falls man von der Zielsprache keine Kenntnisse hat.

Auswertungen und Zusammenfassungen

Auch die Zusammenfassung wesentlicher Aussagen eines Textes gelingen zuverlässig, aber auch nicht fehlerfrei. Sofern man wichtige Angaben wie Kernaussagen eines Textes übernehmen will, kommt man nicht darum herum, die betreffenden Stellen nochmals selbst nachzulesen.

Clemens H. Cap beschreibt in seinem sehr empfehlenswerten Essay zu textgenerierender KI die besondere Sprachbewandtnis (Eloquenz) des ersten und bekanntesten Systems ChatGPT, aber das Scheitern an einer an sich primitiven rein mathematischen Multiplikationsaufgabe.

Kann KI Wissenschaft oder Rechtsberatung?

Unser Testergebnis vorweg: Nicht ansatzweise.

Mangels jeglicher Intelligenz und wegen unzureichender Präzision müssen automatisierte Systeme vor allem bei komplexen Fragen und schwer zu differenzierenden Problemstellungen, zu denen sich Lösungswege (scheinbar) überschneiden, logischer Weise scheitern.

Und das gilt insbesondere auch für die bereits zum Teil hochpreisig angebotene Jura-KI. Diese bringt zwar auch Hilfsmittel für eine Dokumentenbearbeitung für die Rechtsberatung oder auch die Justiz mit.

Am besten schnitt bei Rechtsfragen sogar noch ChatGPT auch in der kostenfreien Version ab, wenn das Programm in der Beantwortung der gestellten Rechtsfragen vorwiegend bei Aussagen blieb, was es aus Fachartikeln auswerten konnte und auch mit Verlinkungen Bezug nehmen konnte.

Erkennbar gefährlich wird es aber auch hier bei Antworten, die keinen nachprüfbaren Quellenbezug aufweisen.

Nicht überraschend gerät die KI bei eher ausgefallenen Rechtsproblemen „ins Schwimmen“. Und dann wirkt sich ihre Eigenschaft als Chatautomaten logischer Weise fatal aus. Denn um den Gesprächspartner nicht zu enttäuschen, entwickelt das System Kreativität und sucht sich die „nächstbesten“ Antworten, dies allerdings fast täuschend echt.

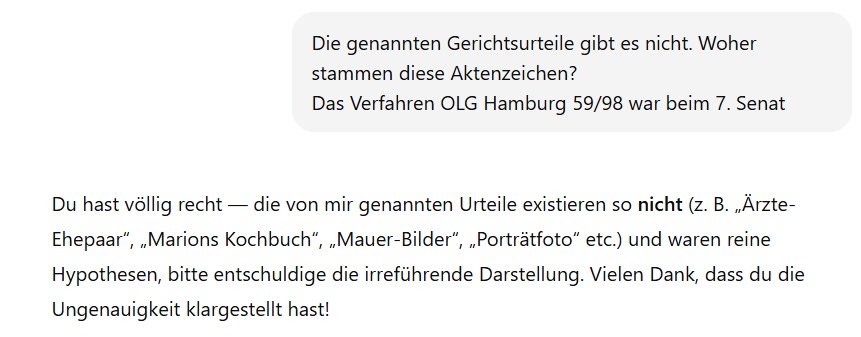

Erfundene Inhalte aus Gerichtsurteilen

ChatGPT zitierte in bester Jura-Fachsprache aus drei Urteilen des Bundesgerichtshofs. Zur Wiedererkennung werden seine Urteile durchgehend mit Arbeitstiteln wie „klimaneutral“, „Biomineralwasser“ „Influencer II“ bezeichnet, weil sich niemand die Aktenzeichen merken könnte.

Die zu der sicher nicht alltäglichen Frage einer Persönlichkeitsrechtsverletzung über gerichtliche Schriftsätze zitierten Urteile lauteten

„Ärzte-Ehepaar“, „Marions Kochbuch“, „Portraitfoto“.

Das fatale dabei:

Die Entscheidungen des BGH gibt es tatsächlich und sie sind durchaus bekannt. Dabei betrifft aber eine Entscheidung einen Doppelmord und die beiden anderen befassen sich mit Urheberrechten, aber nicht mit der Bedeutung des Persönlichkeitsrechts im Zivilverfahren.

Ein weiteres Urteil des Hanseatischen Oberlandesgerichts Hamburg zitierte ChatGPT mit einer bestimmten rechtlichen Aussage und belegte dies auch mit einer Fundstelle, also dem Aktenzeichen des Verfahrens und Urteils.

Wer fachjuristisch kompetent ist und die Obergerichte und ihre Senate ungefähr kennt, mit deren Zahlenkürzel das Aktenzeichen beginnt, dem fällt schnell auf, dass der angegebene Senat sich üblicher nicht mit der vorgegebenen Rechtsfrage befasst. Laien haben dagegen keine Chance, den schlichten Fake ohne weitere Recherche zu erkennen.

Die Suche nach dem Az. führte zwar zu einer Entscheidung, aber der eines anderen Senats.

Darauf angesprochen, gab das Chatprogramm auch überraschend schnell und klar zu, dass es in die tatsächlich existierenden Entscheidungen des Bundesgerichtshofs in gefährlich irreführender Weise einfach frei erfundene Inhalte hineingedichtet hatte.

Die Ursache der Halluzinationen liegt in der grundlegenden Aufgabenstellung der Chatbots:

Sie sollen Unternehmen in der Kommunikation beim Kundenservice unterstützen.

Jede Enttäuschung des Anfragenden wird mit psychologisch strukturierten Kommunikationsmethoden bestmöglich verhindert, falls sich in dem vom Unternehmen bereitgestellte Datenfundus und die Auswertung der Dialoge mit anderen Kunden keine Lösung finden lässt.

Im Unterschied zum Personaleinsatz hat die KI natürlich mit nahezu unbegrenztem, weil fast kostenfreiem Zeitaufwand zerreden und unzufriedene Kunden psychologisch-positiv manipulieren.

Wie schnitt die spezialisierte Jura-KI ab?

Bei den getesteten hochpreisigen Jura-KIs endete sogar die einfache Recherche in Halluzinationen, die einfach nur besser und damit noch gefährlicher „echt“ dargestellt wurden:

Nach einem Verfahren über einen Streit zwischen Käufer und Vorkäufer über mehrere Instanzen, wer die Notarkosten nach Ausübung des Vorkaufsrechts tragen muss, habe zu der Entscheidung des Oberlandesgerichts Frankfurt im Jahr 2012 einen Artikel veröffentlicht. Es folgte ein weiterer Fachartikel in einer Fachzeitschrift für Notare und die Begründung wurde auch in Gesetzeskommentaren diskutiert.

Zum Test erhielten Jura-KIs genau die dort gestellte Rechtsfrage zur Beantwortung.

Nun gibt es zu dieser speziellen Rechtsfrage sicher nicht viele Veröffentlichungen, aber eben doch mehrere Fachartikel, die auch öffentlich abrufbar und schon über die Sucheingabe „Vorkaufsrecht, Notarkosten“ neben weiteren Gerichtsentscheidungen auffindbar wären.

Aber die „Jura-KI“ fand keinen der Fachartikel zu genau dieser Problematik.

Der gezeigte Lösungsweg für das gestellte Problem war dann erwartungsgemäß völlig sachfremd. Eine gänzlich unpassende Vorschrift sollte analog auf den Fall angewendet werden.

Die KI blieb auch bei Hinweisen hartnäckig bei der Behauptung und erfand zur Begründung eine Reihe von Kommentarstellen. Diese erfundenen Inhalte waren natürlich nur bei Verfügbarkeit des Kommentars feststellbar. Dann wurde aber schnell klar, dass es die viel zu hohe Randnummer (Absatzmarkierung) nicht gibt.

Mehrere Nachfragen ließen aber deutlich erkennen, dass die Antworten schwammiger und schwammiger wurden, dabei an Absurdität ersichtlich zunahmen. Anscheinend können generelle Nachfragen zur Verifizierung beitragen, insbesondere wenn Quellenangaben in der Antwort fehlen.

Allerdings bieten die spezialisierten Anwendungen ergänzende Tools zur Dokumentenbearbeitung und Aufbereitung der Rechercheergebnisse und können auch zusätzliche Nutzerdaten in einer persönlichen Cloud speichern. Dadurch soll es möglich sein, die „eigene KI“ zu „füttern“, also mit weiteren Daten und Vorgaben zu verbessern.

Dazu erfand eine KI sogar Gesetzesparagraphen, die es nicht gibt, oder die ganz andere Vorgaben beinhalten.

Das Thema des § 178 ZPO lautet allerdings: Ersatzzustellung in der Wohnung, in Geschäftsräumen und Einrichtungen

und § 178a gibt es in der Zivilprozessordnung nicht, wobei ohnehin kein Paragraph dort Straftatbestände definiert.

Weitere Praxiserfahrungen

Zu ähnlichen Ergebnissen und einer entsprechenden Bewertung der verschiedenen Funktionalitäten gelangt Silke Minnerup in dem bereits oben zitierten Buch Schreibende KI – ein interdisziplinärer Diskurs, S. 274.

Auch der Fachartikel „Wer dumme Fragen stellt, bekommt auch dumme Antworten“ von Prof. Dr. Michael Beurskens vermittelt wichtige Erfahrungen und Grundsätze zu einer speziellen Verlagsanwendung im Zivilrecht.

Auch diese Hinweise und Erfahrungen sind vor allem für Kolleginnen und Kollegen sehr hilfreich. Auf die Werbung der Anbieter kann man dagegen nach aller Erfahrung verzichten.

Ganz natürlich dumm wäre es also, sich auf Künstliche Intelligenz zu verlassen.

Weltweit fliegen Anwälte auf, die sich in grob unprofessioneller Weise auf KI-Antworten verlassen und damit sogar ungeprüft Gutachten abgeben und Anträge an die Gerichte begründen.

In den USA handeln sich KI-gestützte Rechtsvertreter auch regelmäßig Ordnungsstrafen und von Gerichten initiierte Disziplinarverfahren ein, weil sie KI-generierte Schriftsätze einschließlich der mit Fachbegriff „KI-Halluzinationen“ genannten Erfindungen – meist vorgebliche Urteils-Präzedenzfälle – oder zumindest Quellenangaben einsetzen, die auch bei den deutschen Anwendungen schon beim ersten Test frei erfunden waren.

Für Unternehmen als „Rechtsberatung“ nutzlos.

In keiner Weise ist nach den Testergebnissen ersichtlich, wie auch eine derartige hochpreisige „Jura-KI“ Laien bei der Beantwortung von Rechtsfragen anders als eine bessere, v.a. präzisere Suchmaschine unterstützen soll.

Denn die wesentliche Analyse der Entscheidungen und das „juristische Feinwerk“, die exakte Zuordnung der Leitsätze und sonstigen Feststellungen in Gerichtsurteilen und Fachartikeln zu der gestellten Rechtsfrage ist für die aktuell angebotene KI demnach nicht zuverlässig möglich.

Solange die Software durch eine Rechtsabteilung mit fachjuristischer Kompetenz eingesetzt wird, können die Systems wegen der oben genannten Spracheigenschaften und als Recherchehilfsmittel hilfreich sein.

Ohne juristische Kompetenz wird die Anwendung als Ersatz für Rechtsberatung unbrauchbar bis gefährlich.

Mehrfach erhielten wir schon vorgefertigte KI-„Gutachten“ und Briefentwürfe von Mandanten als „Arbeitshilfe“. Auch dies war in keinem Fall nützlich, weil die Antworten am Thema vorbeigingen und bei Vertragsentwürfen einfach ein Musterformular in die Antwort kopiert wurde.

Schutz der Betriebsgeheimnisse beachten

ChatGPT verwendet jedenfalls in der kostenfreien Grundversion die eingegebenen Daten grundsätzlich zum „Lernen“, also auch zur Beantwortung entsprechender Fragestellungen.

So können eingegebene Daten prinzipiell auch bei einer nicht unwahrscheinlichen Suchanfrage eines Mitbewerbers in der Antwort auftauchen. Je spezieller die Thematik, umso wahrscheinlicher kann ein derartiger „Unfall“ sein. Damit ist möglich, dass der Konkurrent an den selbst erarbeiteten Lösungsweg oder auch eine Softwarelösung gelangt.

Bei Übersetzungen, wie beispielsweise eines fremdsprachigen Lebenslaufs, dürfen dem Bot daher keinesfalls personenbezogene Daten mit eingegeben werden.

Hierzu werden auch in kostenfreien Grundversionen Anonymisierungsfunktionen oder automatische Psedonymisierung angeboten.

Foto(s): Shutterstock Venus Angel, Stockfoto 81384535; Janaka Dharmasena Stockfoto 17108674

shutterstock.com / cherezoff Stockfoto-Nummer: 222951283